1. Rastreabilidade integral

Todo artefato, decisão e evento rastreável da origem ao efeito final.

Os princípios gerais do SinergIA definem as regras de conduta que governam todas as decisões do framework — desde a especificação de requisitos até o deploy em produção. Eles se aplicam a todos os pontos de vista, todos os modos de aplicação e a todos os agentes envolvidos, humanos ou de IA.

1. Rastreabilidade integral

Todo artefato, decisão e evento rastreável da origem ao efeito final.

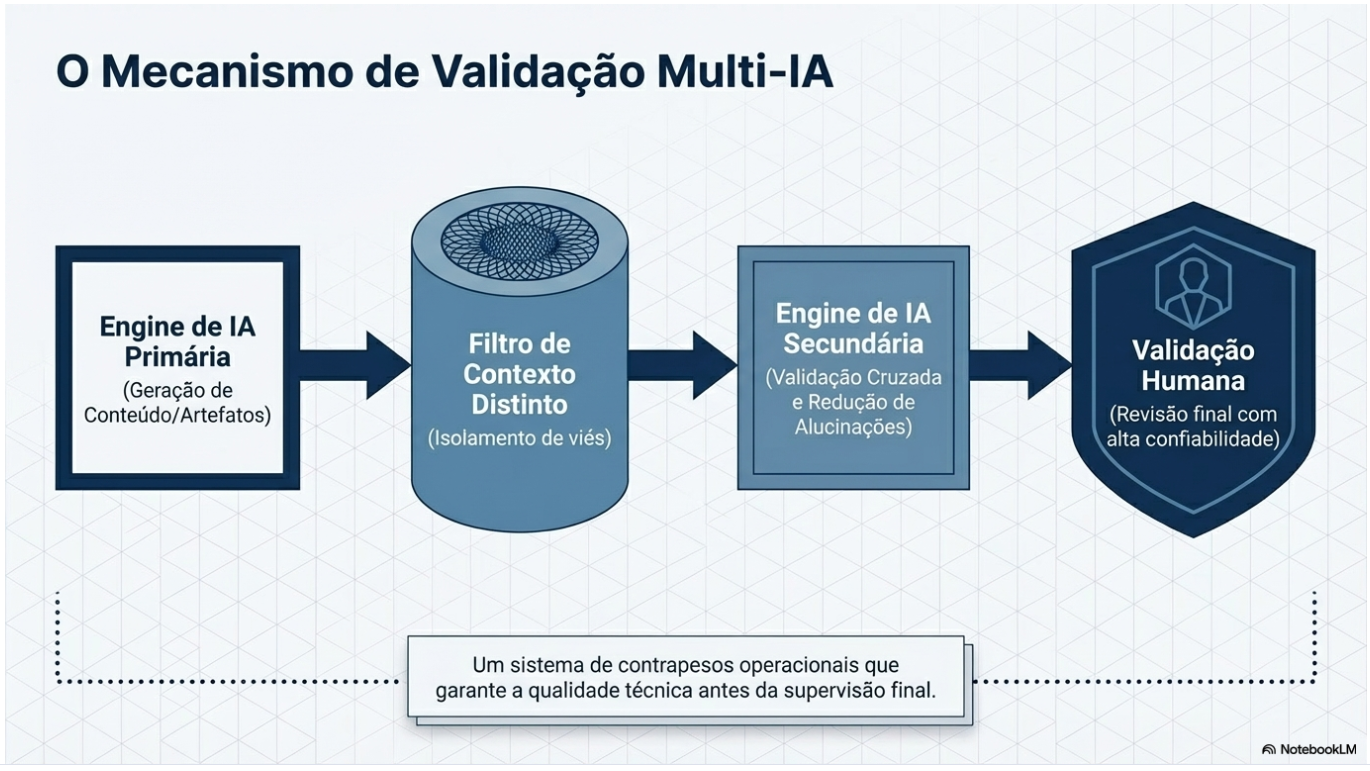

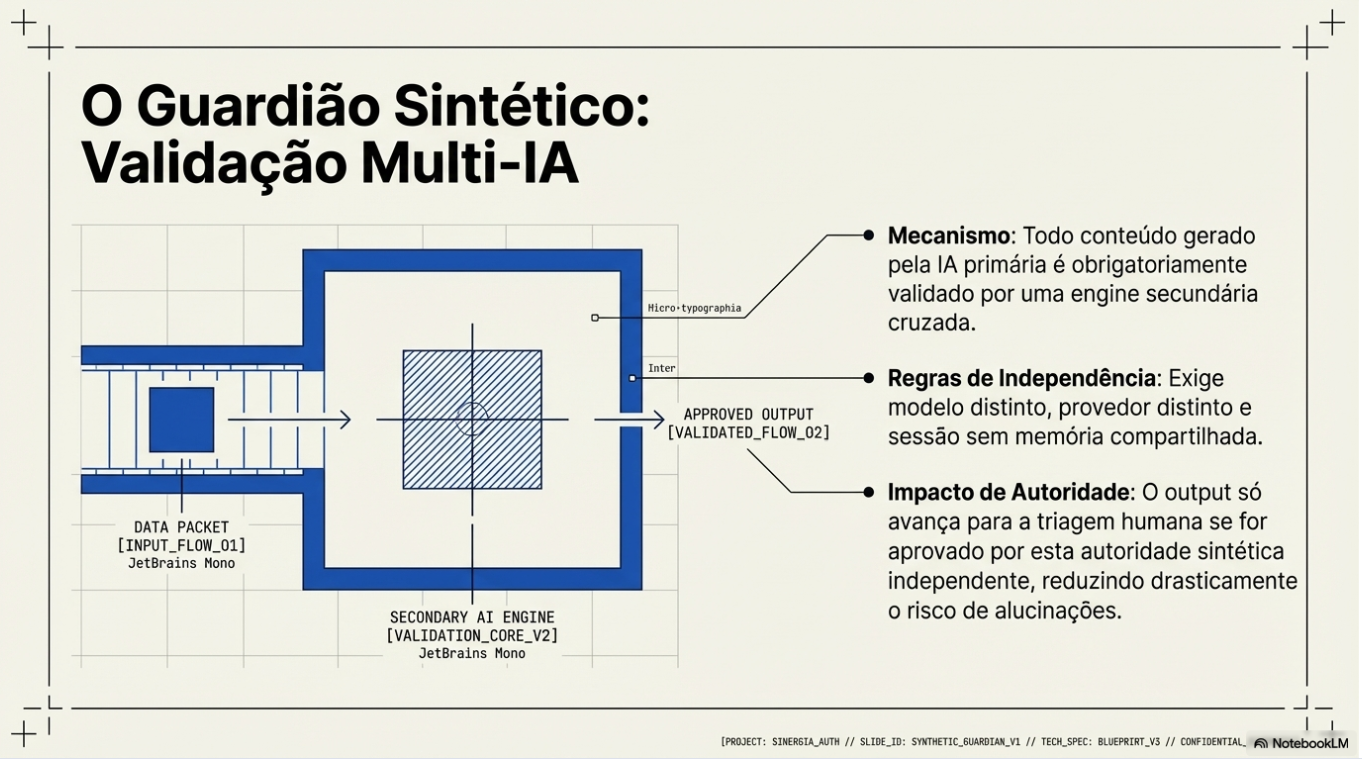

2. Validação em múltiplas camadas

Todo conteúdo gerado por IA validado por outra engine em contexto distinto.

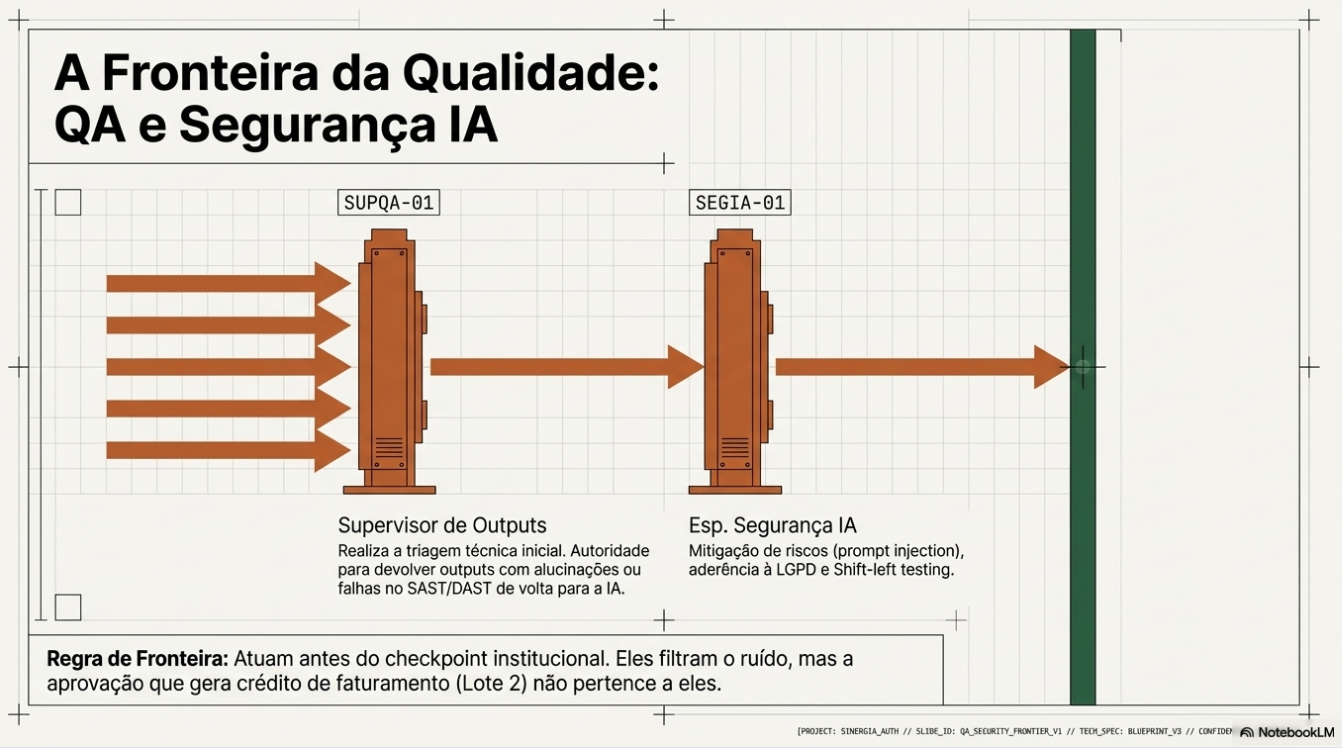

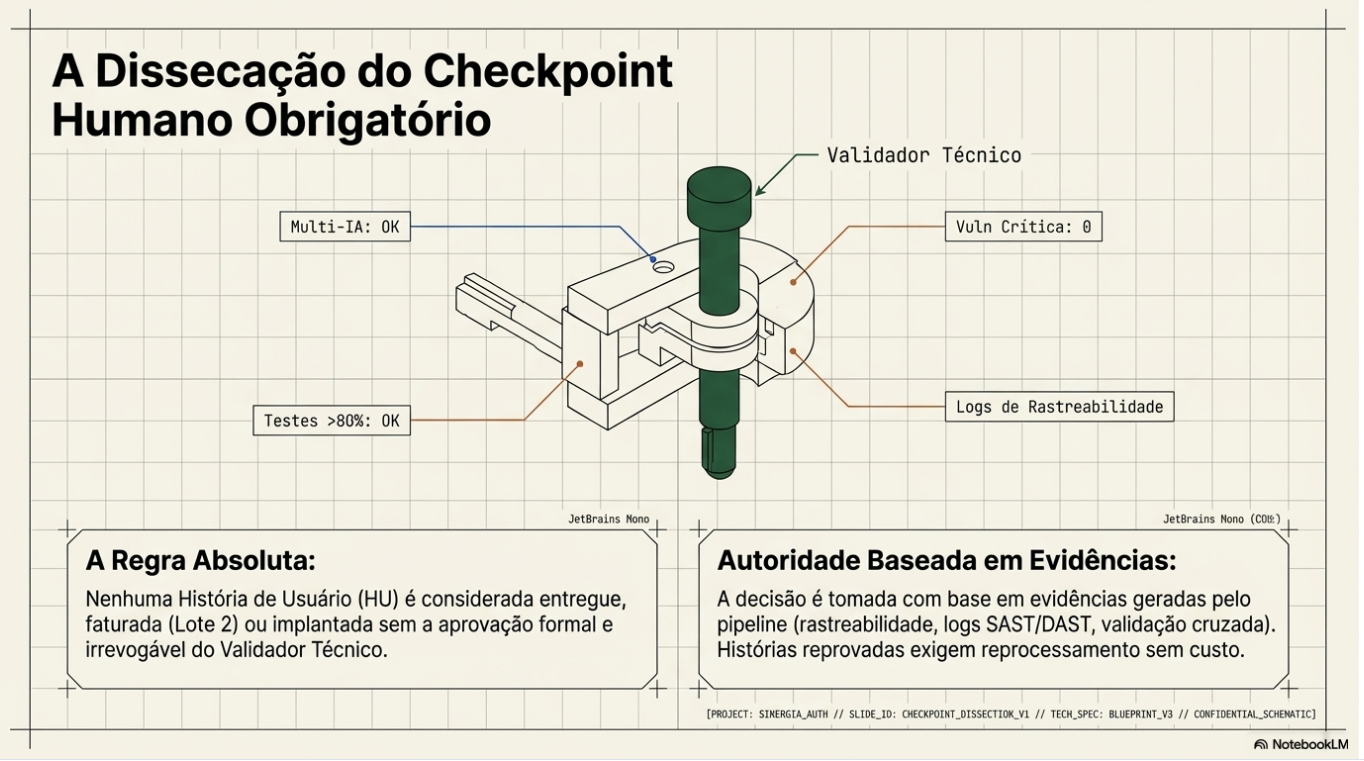

3. Supervisão humana obrigatória

Decisões críticas permanecem submetidas à supervisão humana por papeis definidos na GTI.

4. Segregação por ponto de vista

Cada PV tem organização, versionamento e repositório próprios.

5. Conformidade desde a origem

A solução nasce aderente às diretrizes de segurança, acessibilidade e governança.

6. Evidência mínima obrigatória

Nenhum avanço de fase sem geração e documentação de evidências mínimas.

7. Documentação contínua e modular

Documentação gerada e atualizada continuamente por mecanismos automatizados.

8. Documentação curta

Documentos curtos, objetivos, versionados e interligados por referência.

9. Proporcionalidade

Aplicação calibrada pela criticidade real do projeto, com modos Ágil, Essencial e Completo.

10. Ética e Impacto Social

Toda solução avaliada quanto ao impacto ético, social e nos direitos fundamentais.

Todo artefato, decisão, requisito, implementação, teste, alteração, aprovação, evidência e evento relevante deverá ser rastreável desde sua origem até seu efeito final na solução.

Conceito derivado de: OECD AI Principle 1.4 — Transparência e Explicabilidade · NIST AI RMF — GOVERN 6.1 (rastreabilidade de decisões)

Todo conteúdo gerado por IA deverá ser validado por outra engine de IA em contexto distinto e, quando aplicável, por instância humana mediante papel de supervisão pré-definido.

Conceito derivado de: NIST AI RMF — MEASURE 2.5 (testes de adversário e validação cruzada) · OECD AI Principle 1.3 — Robustez, Segurança e Proteção

Configura “contexto distinto”: modelo de IA diferente, provedor diferente, sessão sem memória compartilhada e perspectiva de análise diferente — por exemplo, uma engine focada em segurança, outra em desempenho ou aderência ao negócio.

A inteligência artificial poderá atuar de forma assistiva ou agêntica, mas as decisões críticas de negócio, arquitetura, segurança, dados, privacidade, conformidade e implantação deverão permanecer submetidas à supervisão humana, exercida por papeis específicos definidos na GTI (Governança de TI).

Conceito derivado de: OECD AI Principle 1.5 — Accountability e Supervisão Humana · NIST AI RMF — GOVERN 1.2 (Human-in-the-Loop e Human-over-the-Loop)

Cada ponto de vista do modelo deverá possuir organização própria, versionamento próprio, repositório próprio e mecanismos próprios de documentação e evidência. A sincronização entre pontos de vista deverá ser garantida por mecanismos de rastreabilidade cruzada definidos na seção Repositórios.

A solução deverá nascer aderente às diretrizes de negócio, segurança, acessibilidade, identidade visual, governança de dados, proteção de dados pessoais e padrões institucionais e governamentais aplicáveis.

Nenhum avanço relevante de fase poderá ocorrer sem geração e documentação de evidências mínimas de aderência, qualidade, segurança, completude, versionamento e validação.

A documentação deverá ser gerada e atualizada continuamente por mecanismos automatizados, sempre indicando versão, data da última alteração, autores das últimas alterações e vínculo com os artefatos relacionados.

Deverá ser evitada a produção de documentos longos. O padrão preferencial será o de documentos curtos, objetivos, versionados, interligados por referência e organizados em estrutura navegável por pastas, índices ou catálogos.

A aplicação do framework deverá ser proporcional à criticidade, sensibilidade, complexidade e impacto do projeto. Projetos de baixa criticidade não deverão ser submetidos ao conjunto completo de exigências, utilizando os modos de aplicação definidos na seção Modos de Aplicação.

Conceito derivado de: NIST AI RMF — GOVERN 4.1 (calibração de controles por nível de risco) · OECD AI Principle 1.2 — Bem-estar e proporcionalidade

Toda solução desenvolvida com IA deve ser avaliada quanto ao seu impacto ético, social e nos direitos fundamentais dos cidadãos — em especial equidade, não discriminação, transparência, explicabilidade e sustentabilidade socioambiental.

A avaliação de impacto ético é obrigatória em projetos de risco médio, alto ou excessivo, conforme a classificação definida no Framework AIE Gov.BR, instrumento consultivo oficial da SGD/MGI para governança ética de IA no setor público federal.

← Introdução · Próximo: Ética e Impacto Social →